дисковая полка что это

Наращиваем дисковую массу без стероидов. Обзор 102-дисковой полки Western Digital Ultrastar Data102 и конфигурации СХД

Чем хороши большие JBOD’ы?

Новый JBOD Western Digital на 102 диска по 12ТБ получился мощным. При разработке этого JBOD были учтены предыдущий опыт с двумя поколениями 60-дисковых полок.

Data102 получился на редкость для таких гигантов сбалансированным по объему и производительности.

Зачем же нужны такие большие дисковые корзины, когда в мире растет популярность гиперконвергентных систем?

Задачи, при которых требования по объемам хранения значительно превышают требования по вычислительной мощности, могут раздуть бюджет заказчика до невероятных размеров. Вот лишь несколько примеров и сценариев:

Чем хорош JBOD от Western Digital?

Мы прекрасно понимаем, что модульные системы ограничены по масштабируемости возможностями контроллеров и что сеть всегда создает задержки. Но при этом такие системы обладают более низким стоимостью IOps, GBps и ТБ хранения.

Есть две вещи, за которые инженеры RAIDIX полюбили Data102:

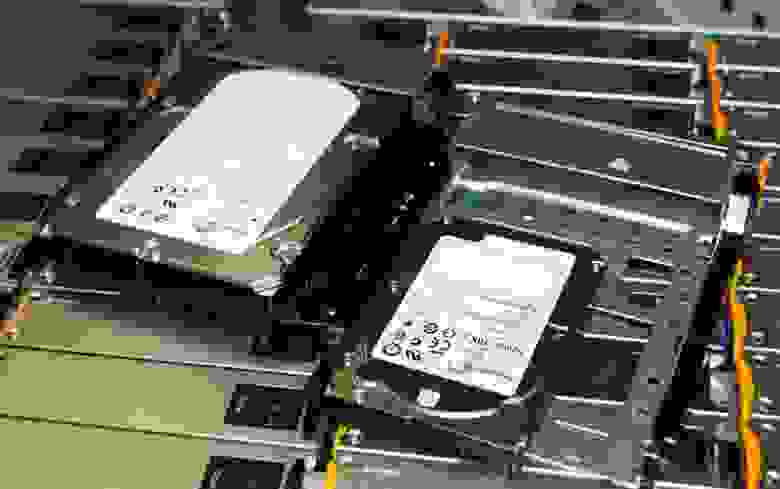

Зря боялись. Заботясь об инженерах, в Western Digital придумали новый способ крепления диска, который позволяет облегчить обслуживание. Диски крепятся к шасси c помощью фиксирующих зажимов, без болтов и винтов. Все диски механически изолируются с помощью эластичных крепежей на задней панели. Новая прошивка сервопривода и акселерометры отлично компенсируют вибрацию.

Что у нас в коробке?

В коробке — корпус корзины, набитый дисками. Купить можно минимум 24 диска, а масштабируется решение наборами по 12 дисков. Делается это для того, чтобы обеспечить правильное охлаждение и бороться с вибрацией наилучшим образом.

Кстати, именно развитие двух вспомогательных технологий — IsoVibe и ArcticFlow — сделали возможным рождение нового JBOD’а.

Состоит IsoVibe из следующих компонентов:

Температура — это второй после вибрации фактор, убивающий жесткие диски. При средней температуре работы выше 55C наработка на отказ жесткого диска будет в два раза меньше расчетной.

От плохого охлаждения особенно страдают серверы с большим количеством дисков и большие дисковые полки. Зачастую задние ряды дисков греются на 20 и более градусов больше, чем диски, находящиеся вблизи от холодного коридора.

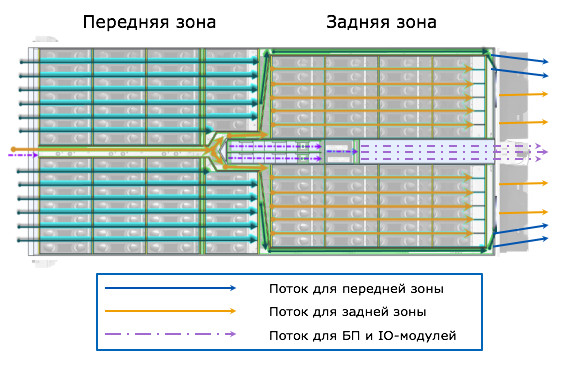

ArcticFlow — это запатентованная Western Digital технология охлаждения полки, смысл которой заключается в создании дополнительных воздуховодов внутри шасси, которые позволяют протягивать холодный воздух к задним рядам дисков напрямую из холодного коридора, минуя передние ряды.

Рис. 2. Принцип работы ArcticFlow

Отдельный поток холодного воздуха построен для охлаждения модулей ввода-вывода и блоков питания.

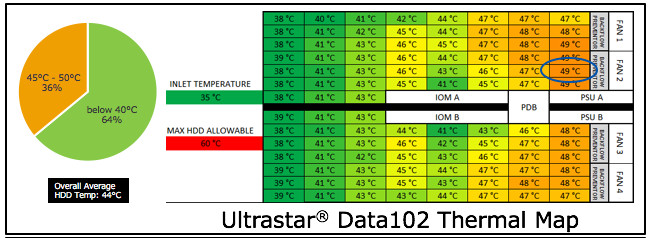

Результат — великолепная термальная карта работающей полки. Разброс температур между передними и задними рядами дисков — 10 градусов. Самый горячий диск — 49C при температуре в «холодном» коридоре +35C. На охлаждение каждого диска тратится 1.6Вт — в два раза меньше, чем у других подобных шасси. Вентиляторы работают тише, вибрация меньше, диски живут дольше и работают быстрее.

Рис. 3. Температурная карта Ultrastar Data 102

Учитывая бюджет по питанию в 12Вт на один диск, полку легко можно сделать гибридной — из 102 дисков 24 могут быть SAS SSD. Их можно установить и использовать как в гибридном режиме, так и настроив SAS Zoning и передав хосту, нуждающемуся в all-flash.

Еще у нас в коробке есть салазки для крепления в стойку. Для установки JBOD нужна парочка физически сильных инженеров. Вот с чем они столкнутся:

Давайте взглянем на эту систему. Спереди все просто и лаконично.

Рис. 4. Ultrastar Data 102. Вид спереди

Одной из самых интересных особенностей JBOD является установка IO-модулей сверху!

Рис. 5. Ultrastar Data 102

Рис. 6. Ultrastar Data 102. Вид сверху

Рис. 7. Ultrastar Data 102. Вид сверху без дисков

Сзади у JBOD для каждого IO-модуля есть по 6 SAS 12G портов. Итого мы получаем 28800 MBps пропускной способности бэкенда. Порты можно использовать как для подключения к хостам, так и частично для каскадирования. Портов для питания системы два (80+ Platinum rated 1600W CRPS).

Рис. 8. Ultrastar Data 102. Вид сзади

Производительность

Как мы и говорили, Data102 не просто огромен — он быстрый! Результаты тестов, проведенных вендором, таковы:

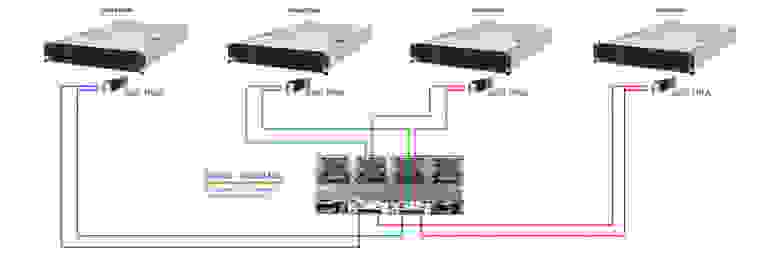

Рис. 10. Параллельная нагрузка с 6-ти серверов

Управление

Управлять JBOD со стороны софта можно двумя способами:

Это полезно использовать, если у вас диск подвешивает всю SAS-шину.

Типовые конфигурации

Для того, чтобы использовать возможности такого JBOD с максимальной пользой, нам потребуются RAID-контроллеры или программное обеспечение. Здесь на выручку и приходит ПО RAIDIX.

Для создания отказоустойчивой СХД нам потребуются два узла хранения и одна или более корзин с SAS дисками. Если же мы не хотим внедрять защиту от отказа узла или использовать репликацию данных, то можно подключить к корзине один сервер и использовать SATA диски.

Двухконтроллерная конфигурация

В качестве контроллеров для СХД на основе RAIDIX могут использоваться практически любые серверные платформы архитектуры x86: Supermicro, AIC, Dell, Lenovo, HPE и многие другие. Мы постоянно ведем работу над сертификацией нового оборудования и портируем наш код под различные архитектуры (например, «Эльбрус» и OpenPower).

Для примера возьмем платформу Supermicro и попытаемся достичь максимально возможной пропускной способности и плотности вычислений. При «сайзинге» серверов будем использовать шину PCI-E, куда установим back-end и front-end контроллеры.

Также нам понадобятся контроллеры для подключения дисковой полки, не менее двух AVAGO 9300-8e. Альтернативно: пара 9400-8e или один 9405W-16e, но для последнего понадобится полноценный слот x16.

Следующий компонент — слот для канала синхронизации. Это может быть Infiniband или SAS. (Для задач, где пропускная способность и задержки не критичны, можно обойтись синхронизацией через корзину без выделенного слота.)

Ну и, конечно, нам будут нужны слоты для хост-интерфейсов, которых тоже должно быть никак не менее двух.

Итого: каждому контроллеру нужно иметь от 5 слотов x8 (без запаса для дальнейшего масштабирования). Для построения недорогих систем, ориентированных на производительность в 3–4 ГБ/с на узел, мы можем обойтись всего двумя слотами.

Варианты конфигурации контроллеров

Supermicro 6029P-TRT

Контроллеры можно разместить в двух 2U серверах 6029P-TRT. Они не самые богатые в плане PCI-E cлотов, но зато на них установлена стандартная материнская плата без рейзеров. На этих платах гарантированно «заведутся» NVDIMM-N модули от Micron для защиты кэша от отказов питания.

Для подключения дисков возьмем Broadcom 9400 8e. Грязные сегменты кэша будем синхронизировать через IB 100Gb.

Внимание! Приведенные ниже конфигурации рассчитаны на максимальную производительность и функционирование всех имеющихся опций. Для вашей конкретной задачи спецификация может быть существенно сокращена. Обращайтесь к нашим партнерам.

Конфигурация системы, которая у нас получилась:

| № | Наименование | Описание | P/N | Кол-во на один RAIDIX DC |

|---|---|---|---|---|

| 1 | Платформа | SuperServer 6029P-TRT | SYS-6029P-TRT | 2 |

| 2 | CPU | Intel Xeon Silver 4112 Processor | Intel Xeon Silver 4112 Processor | 4 |

| 3 | Memory | 16GB PC4-21300 2666MHz DDR4 ECC Registered DIMM Micron MTA36ASF472PZ-2G6D1 | MEM-DR416L-CL06-ER26 | 12 |

| 4 | System Disk | SanDisk Extreme PRO 240GB | SDSSDXPS-240G-G25 | 4 |

| 5 | Hot-swap 3.5″ to 2.5″ SATA/SAS Drive Trays | Tool-less black hot-swap 3.5-to-2.5 converter HDD drive tray (Red tab) | MCP-220-00118-0B | 4 |

| 6 | HBA for cache-sync | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 2 |

| 7 | HBA for JBOD connection | Broadcom HBA 9400-8e Tri-Mode Storage Adapter | 05-50013-01 | 4 |

| 8 | Ethernet patchcord | Ethernet patch cord for cache sync 0.5m | 1 | |

| 9 | Cable for cache sync | Mellanox passive copper cable, VPI, EDR 1m | MCP1600-E001 | 2 |

| 10 | HBA for host connection | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 2 |

| 11 | SAS cable | Storage Enclosure Ultrastar Data102 Cable IO HD mini-SAS to HD mini-SAS 2m 2Pack | 8 | |

| 12 | JBOD | Ultrastar Data102 | 1 | |

| 13 | RAIDIX | RAIDIX 4.6 DC/NAS/iSCSI/FC/SAS/IB/SSD-cache/QoSmic/SanOpt/Extended 5 years support/unlimited disks/ | RX46DSMMC-NALL-SQ0S-P5 | 1 |

Вот примерная схема:

Рис. 11. Конфигурация на базе Supermicro 6029P-TRT

Supermicro 2029BT-DNR

Если мы хотим побороться за пространство в серверной, то за основу контроллеров хранения можно взять Supermicro Twin, например, 2029BT-DNR. Данные системы имеют по 3 PCI-E слота и по одному IOM-модулю. Среди IOM есть нужный нам Infiniband.

Конфигурация:

| № | Наименование | Описание | P/N | Кол-во на один RAIDIX DC |

|---|---|---|---|---|

| 1 | Платформа | SuperServer 2029BT-DNR | SYS-2029BT-DNR | 1 |

| 2 | CPU | Intel Xeon Silver 4112 Processor | Intel Xeon Silver 4112 Processor | 4 |

| 3 | Memory | 16GB PC4-21300 2666MHz DDR4 ECC Registered DIMM Micron MTA36ASF472PZ-2G6D1 | MEM-DR416L-CL06-ER26 | 12 |

| 4 | System Disk | Supermicro SSD-DM032-PHI | SSD-DM032-PHI | 2 |

| 5 | HBA for cache-sync | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 2 |

| 6 | HBA for JBOD connection | Broadcom HBA 9405W-16e Tri-Mode Storage Adapter | 05-50044-00 | 2 |

| 7 | Ethernet patchcord | Ethernet patch cord for cache sync 0.5m | 1 | |

| 8 | Cable for cache sync | Mellanox passive copper cable, VPI, EDR 1m | MCP1600-E001 | 2 |

| 9 | HBA for host connection | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 2 |

| 10 | SAS cable | Storage Enclosure Ultrastar Data102 Cable IO HD mini-SAS to HD mini-SAS 2m 2Pack | 8 | |

| 11 | JBOD | Ultrastar Data102 | 1 | |

| 12 | RAIDIX | RAIDIX 4.6 DC/NAS/iSCSI/FC/SAS/IB/SSD-cache/QoSmic/SanOpt/Extended 5 years support/unlimited disks | RX46DSMMC-NALL-SQ0S-P5 | 1 |

Вот примерная схема:

Рис. 12. Конфигурация на базе Supermicro 2029BT-DNR

Платформа 1U

Часто возникают задачи, где требуется максимальная плотность размещения больших объемов данных, но не требуется, например, полная отказоустойчивость по контроллерам. В этом случае мы берем за основу систему 1U и подключаем к ней максимальное количество дисковых полок.

Scale-Out система

В качестве последнего упражнения в нашей тренировке построим горизонтально-масштабируемую систему на основе HyperFS. Для начала мы выберем 2 типа контроллеров – для хранения данных и для хранения метаданных.

Контроллерами хранения назначим SuperMicro 6029P-TRT.

Для хранения метаданных используем несколько SSD накопителей в корзине, которые мы объединим в RAID и отдадим MDC через SAN. На одну систему хранения мы можем подключить до 4 JBOD каскадом. Итого в одной глубокой стойке размещаем X PB данных с единым пространством имен.

| № | Наименование | Описание | P/N | Кол-во на один RAIDIX DC |

|---|---|---|---|---|

| 1 | Платформа | SuperServer 6029P-TRT | SYS-6029P-TRT | 2 |

| 2 | CPU | Intel Xeon Silver 4112 Processor | Intel Xeon Silver 4112 Processor | 4 |

| 3 | Memory | 16GB PC4-21300 2666MHz DDR4 ECC Registered DIMM Micron MTA36ASF472PZ-2G6D1 | MEM-DR416L-CL06-ER26 | 16 |

| 4 | System Disk | SanDisk Extreme PRO 240GB | SDSSDXPS-240G-G25 | 4 |

| 5 | Hot-swap 3.5″ to 2.5″ SATA/SAS Drive Trays | Tool-less black hot-swap 3.5-to-2.5 converter HDD drive tray (Red tab) | MCP-220-00118-0B | 4 |

| 6 | HBA for cache-sync | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 2 |

| 7 | HBA for JBOD connection | Broadcom HBA 9400-8e Tri-Mode Storage Adapter | 05-50013-01 | 4 |

| 8 | Ethernet patchcord | Ethernet patch cord for cache sync 0.5m | 1 | |

| 9 | Cable for cache sync | Mellanox passive copper cable, VPI, EDR 1m | MCP1600-E001 | 2 |

| 10 | HBA for host connection | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 2 |

| 11 | SAS cable | Storage Enclosure Ultrastar Data102 Cable IO HD mini-SAS to HD mini-SAS 2m 2Pack | 8 | |

| 12 | JBOD | Ultrastar Data102 | 1 | |

| 13 | RAIDIX | RAIDIX 4.6 DC/NAS/iSCSI/FC/SAS/IB/SSD-cache/QoSmic/SanOpt/Extended 5 years support/unlimited disks/ | RX46DSMMC-NALL-SQ0S-P5 | 1 |

| 14 | Платформа (MDC HyperFS) | SuperServer 6028R-E1CR12L | SSG-6028R-E1CR12L | 1 |

| 15 | CPU (MDC HyperFS) | Intel Xeon E5-2620v4 Processor | Intel Xeon E5-2620v4 Processor | 2 |

| 16 | Memory (MDC HyperFS) | 32GB DDR4 Crucial CT32G4RFD424A 32Gb DIMM ECC Reg PC4-19200 CL17 2400MHz | CT32G4RFD424A | 4 |

| 17 | System Disk (MDC HyperFS) | SanDisk Extreme PRO 240GB | SDSSDXPS-240G-G25 | 2 |

| 18 | Hot-swap 3.5″ to 2.5″ SATA/SAS Drive Trays (MDC HyperFS) | Tool-less black hot-swap 3.5-to-2.5 converter HDD drive tray (Red tab) | MCP-220-00118-0B | 2 |

| 19 | HBA (MDC HyperFS) | Mellanox ConnectX-4 VPI adapter card, EDR IB (100Gb/s), dual-port QSFP28, PCIe3.0 x16 | MCX456A-ECAT | 1 |

Вот примерная схема подключения:

Рис. 13. Конфигурация Scale-Out системы

Заключение

Работа с большими объемами данных, особенно на write-intensive паттернах – очень непростая задача для СХД, классическим решением которой является приобретение shared-nothing scale-out систем. Новый JBOD от Western Digital и ПО RAIDIX позволит построить СХД на несколько петабайт и несколько десятков GBps производительности значительно дешевле, чем при использовании горизонтально-масштабируемых систем, и мы советуем обратить ваше внимание на такое решение.

JBOD — недорогое файловое хранилище для 2021 года

Количество информации, которую требуется хранить, увеличивается из года в год. Если раньше хватало пары десятков килобайт, то сейчас недостаточно сотен терабайт, в особо сложных случаях даже тысяч. Дешевые хранилища с ограниченными возможностями стали довольно востребованы. Хоть к скорости дисковой подсистемы тоже высоки, но в некоторых случаях необходимы недорогие хранилища без претензий на отказоустойчивость.

JBOD (аббр. Just a bunch of disk, просто куча дисков) — тип хранилища, представляющий собой набор жестких дисков, объединенных таким образом, что отображаются словно единый сетевой диск. Соответственно, ни о каких массивах речи и быть не может. Объединять отдельные дисковые полки в массивы либо создавать оный в пределах JBOD нельзя. Фактически, это самый простой тип хранилища данных. Обычный файловый набор с низкой отказоусточивостью, ведь при отказе одного HDD, негативные последствия скажутся на всей файловой системе.

На данный момент самый выгодный вариант дисковой полки можно заказать у компании Сервер Гид. У них есть варианты от производителей Supermicro и Western Digital, а это наиболее дешевые и качественные варианты на рынке.

Как устроен JBOD

Сей тип СХД довольно прост, потребуется контроллер с поддержкой одноименного режима, полка для размещения и подключения. Все диски подключаются через объединительные платы и переходники к контроллеру, который впоследствии будет этой кучей накопителей управлять.

Никто не мешает построить JBOD на базе более дорогой серверной платформы, но стоимость платформы сделает подобные вложения невыгодными. Пример ниже.

В принципе, «кучу дисков» можно создавать без подобного корпуса, что еще сильнее удешевит итоговый вариант, но стоит ли оно того, учитывая, что станет менее удобно компоновать дисковую полку и могут возникнуть проблемы размещения? Вопрос хороший, но решать вам… И бюджету.

Ладно, как выглядит это дело, вполне ясно, поговорим о более специфических вещах.

Интерфейсы

JBOD поддерживает практически все современные логические и физические интерфейсы накопителей, но ограничено применение целесообразностью, строить ДП на SSD NVMe попросту глупо и экономически нецелесообразно, потому сейчас наиболее распространены:

Наиболее популярен SATA и, как ни удивительно, практически отмерший IDE. Накопители с первым типом дешевы и дают приемлемую эффективность, SAS довольно дорог, имеет значительно меньший объем, потому применяется редко. Small Computer System Interface свое давно отжил, устройства с таким набором стандартов встречаются редко. IDE или более распространенная аббревиатура ATA – предшественник SATA и последним попросту вытеснен, но использовать в JBOD старые HDD IDE никто не мешает, что многие делают. Впрочем, найти накопители на замену трудно, потому наиболее предпочтителен SATA-интерфейс.

HDD или SSD?

Дисковая полка, исполненная на SSD вполне возможна. Ничто не мешает сделать это, кроме экономической целесообразности. Твердотельные накопители довольно дороги, а JBOD есть смысл применять только в том случае, если недостаточно денег на более эффективные типы систем хранения данных, например NAS или SAN с RAID- массивами. Потому сфера применения четко ограничена не только техническим возможностями, но и экономикой.

Контроллеры

Подойдет любой контроллер с поддержкой JBOD и внешними портами, для формирования полки нужен контроллер с внутренними портами для объединения HDD. Наиболее дешевые модели у Supermicro, WD, Huawei. Дорогие нецелесообразны. Многие RAID- контроллеры имеют встроенную поддержку объединения дисков таким методом.

Преимущества и недостатки JBOD

К несчастью, это не самый эффективный способ работы с файловыми системами. Попробую объяснить почему. Начнем с преимуществ, которых, к сожалению, не так уж много:

Низкая стоимость. Пожалуй, единственная причина, по которой дисковая полка не ушла в прошлое.

Возможность объединения накопителей с разным интерфейсом. Можно подключать HDD через HBA- контроллеры, а те присоединять к JBOD- контроллеру. Не очень просто, но если валяются не приспособленные никуда накопители, почему бы не поступить так?

Можно использовать диски с разными параметрами : скорость, вращение головки, объем. Разница в технических характеристиках скажется только на общей скорости системы. Самый медленный HDD станет ограничением по скорости для всего устройства.

Пожалуй, на сих невпечатляющих преимуществах список можно и закончить. Как видите, ничего выдающегося нет, зато недостатки вполне впечатляющие:

Файловую систему требуется постоянно дефрагментировать, если фрагменты файлов будут разбросаны по разным накопителям, то выход из строя одного, затронет и другие. К тому же, серьезная фрагментация плохо скажется на скорости.

Максимальная скорость массива определяется самым медленным жестким диском, потому нет смысла ставить производительные диски в комплекте с менее шустрыми. Конечно, скорость HDD давно серьезно не менялась, но современные диски работают немного быстрее.

Отказ одного диска не затронет файловое пространство других, но данные на нем безвозвратно потеряются, если не сделана резервная копия. Потому, если фрагменты разбросаны по разным накопителям, и часть фрагментированного файла будет на отказавшем диске, он будет поврежден.

Отсутствие RAID. К сожалению, JBOD всего лишь сетевой диск, массивом в полной мере подобная система не является.

Плохая защита данных. Защитить можно только извне посредством сервера или другой вычислительной техники.

В целом, простой тип СХД. Никаких изысков, а простая дисковая полка. Подойдет в качестве файлового хранилища для всякой ерунды. В силу плохой встроенной защиты данных и невозможности обеспечить полноценную сохранность информации, использовать рекомендуется только для несерьезных задач.

Перспективы JBOD в 2021 году

Дисковые полки будут еще долго востребованы. Они дешевы и не требуют серьезных усилий в обслуживании конфигурации. В качестве места размещения архивных данных использовать можно. Единственный недостаток — низкий уровень отказоустойчивости, но с этим ничего не поделаешь. Формирование RAID станет более дорогим удовольствием.

В этот период времени сферы приложения для устройства найдутся. Главное, отдавать себе отчет в том, что для хранения важной информации подобная платформа не подходит. А вот в качестве файлопомойки для офиса — вариант идеальный.

Выводы

JBOD – полезная вещь, если нет серьезных требований к сохранности данных и надежности. Можно туда скидывать старые бэкапы, всякий ненужный хлам, который удалить жалко, но и держать смысла нет и прочую информацию, которая в перспективе не пригодится вообще. Кстати, наиболее выгодные варианты по дисковым полкам сейчас предоставляет компания «Сервер Гид». Сэкономите много времени и средств, если обратитесь к ним.

Дисковая полка ETegro Fastor JS300 G3

В наших прошлых обзорах мы уже несколько раз говорили о возможности расширения дискового пространства серверов при помощи дисковых полок. Сегодня мы решили показать, на что, собственно, похожи наши дисковые полки на примере ETegro Fastor JS300 G3.

Но сперва краткий экскурс в терминологию и, собственно, причины существования дисковых полок. Дисковая полка является типичным примером DAS, то есть Directed Attached Storage – накопителя с блочным доступом к данным. С точки зрения работы с данными это более простое устройство, чем NAS, поскольку вся работа на уровне файловой структуры находится вне ведома самого устройства. Хотя, конечно же, DAS уровня Enterprise гораздо сложнее, чем простые домашние NAS.

Для начала напомним, что в мире современных серверов дисковые полки используются в качестве внешней дисковой подсистемы. Подключение к серверам можно организовать довольно гибко. Вот для примера несколько различных нетривиальных вариантов подключения.

Что же касается требований к дисковым полкам, то они очень сильно различаются от класса устройств и как всегда влекут за собой существенную разницу в цене. Мы относим ETegro Fastor JS300 G3 к дисковым полкам High-End уровня, соответственно выполняя необходимые требования: полки обладают дублированными контроллерами и блоками питания с поддержкой горячей замены, не имеют единой точки отказа и обладают мощной избыточной системой вентиляции с возможностью горячей замены всех модулей.

Издалека полка выглядит стандартным металлическим ящиком, то есть мало чем отличается от других стоечных шасси высотой 4U. Вблизи вид уже интересней – дизайн не требует установки крышки, что облегчает горячую замену дисков без полного выдвижения полки из стойки. Большую часть внутреннего пространства корпуса занимают 60 жестких дисков, расположившиеся в 5 рядов по 12 дисков в каждом. Несложно подсчитать, что максимальная емкость одной дисковой полки при заполнении ее 4-ТБ дисками составляет 240 ТБ, то есть почти четверть петабайта.

Все диски размещаются на универсальных металлических салазках (треях), обеспечивающих установку как 3,5-дюймовых, так и 2,5-дюймовых накопителей, так что если вам жизненно необходима полка на SSD – никаких проблем.

Отсутствие верхней крышки – это выгодная конструктивная особенность именно Fastor JS300 G3, то, что отличает его от других предложений на рынке. Взамен крышки верхние панели треев выполнены из металла и снабжены индикацией состояния диска. При этом индикация дублируется на переднюю панель. Т.е. все сделано для простоты нахождения и обслуживания дисков в случае сбоя.

На фото можно оценить, как индикация полки выглядит в темном помещении.

Раз уж зашел разговор про индикацию, то стоит вспомнить и про внешний вид передней панели полки. Большую ее часть занимает решетка системы охлаждения, через которую видна индикация дисков, а на небольшом островке приютились две группы по 5 индикаторов. Одна из них отображает состояние каждой из пяти групп по 10 дисков, а во второй расположились светодиоды состояния всей системы, вентиляторов, блоков питания, SIM и ISIM модулей.

Задняя панель традиционно раскрывает весь набор компонентов устройства. В данном случае мы видим торжество симметрии, говорящее о высокой степени дублированния модулей полки. Ну а характерные ручки очень тонко намекают, что все модули поддерживают горячую замену. Внизу по углам расположилась пара блоков питания, по 1400 Вт каждый, совершенно стандартных для всей нашей продукции (а что поделать, нам и нашим клиентам чертовски нравится слово «взаимозаменяемость»). Между ними расположилась пара SIM (SAS Interface Module) модулей. Именно они отвечают за дублирование канала связи с SAS контроллером сервера. Версия SAS, конечно же, 6 Гбит/с.

Особо внимательные наверняка обратили внимание на надписи «cascade in» и «cascade out». Их существование объясняется просто: к одному серверу можно каскадом подключить сразу две полки Fastor JS300 G3, причем вторая подключается последовательно к первой как раз к порту «cascade out». Впрочем, две полки можно поделить и между двумя серверами, тогда «входящими» портами являются первый и третий, а второй и четвертый становятся в каждом SIM-модуле исходящими. Если же мы используем только одну полку, то ее можно разделить на четыре сервера сразу, сделав все SAS-порты «входящими».

Дополняют структуру контроллеров 4 внутренних модуля ISIM (Internal SAS Interface Module) для обеспечения полной отказоустойчивости доступа к дискам. Они расположены внутри корпуса по центру первых четырех рядов дисков. Как и все остальное, они поддерживают горячую замену, обладают индикацией статуса и идентификационным светодиодом.

И не забудем систему охлаждения. Оно здесь весьма серьезное, ведь 60 дисков под серьезной нагрузкой являются мощным источником тепла. За охлаждение отвечают 4 вентиляторных модуля с горячей заменой, каждый из которых объединяет два внушительных вентилятора.

Ну, а завершим обзор мы уже ставшим традиционным приглашением задавать вопросы в комментариях. Welcome 🙂