для чего можно использовать видеокарту

Зачем в современном офисе нужна видеокарта

Сегодня мы наблюдаем достаточно необычный процесс: согласно закону Мура, все вычислительные компьютерные мощности на планете удваиваются каждые два года. Необычно, но этот закон не давал осечек, и мы как раз приближаемся к моменту, когда его исполнение просто больше не будет возможно из-за архитектуры ЦПУ.

В пользу этого предположения говорит и то, что в современной IT-отрасли роль видеокарт растет год от года. И хотя бизнес-сегмент сравнительно менее заинтересован в использовании ГПУ, в офисах, офисных и корпоративных серверных видеокарт тоже становится все больше и больше!

Может быть, они нужны и вам, просто вы еще не поспели за трендом? Давайте разберемся, зачем GPU может понадобится в офисе.

Видеокарта для дизайнера, видеомонтажера и аниматора

В последнем случае, то есть для работы дизайнера, по-настоящему мощные графические процессоры обычно монтируются в сервер, с которого через них работает сразу группа сотрудников. Исключение могут составить разве что художники, переходящие с 2D в 3D.

Видеокарта для майнинга

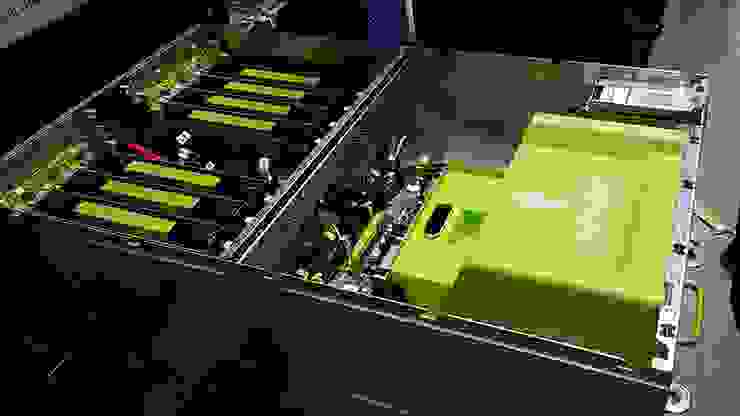

Родилась даже особая архитектура: из серверных запчастей составлялось слабое подобие сервера начального уровня с минимумом процессорной мощности, оперативной памяти и плохоньким жестким диском. К этому всему цеплялось до восьми видеокарт, чью работу эта «архитектура» и должна была обеспечивать. Сегодня по всему миру стоят десятки тысяч таких ферм.

Видеокарта для специалиста по безопасности

Неожиданно, правда? Тем не менее в последние годы этот тренд только крепнет: благодаря большому количеству ядер, видеокарты проще использовать для перебора паролей и взлома документов и сетей. Поэтому, если вы опасаетесь такого рода нападения, то вам понадобится зеркально подобное решение: провести тестирование на проникновение с помощью точно таких же видеокарт и программ для взлома.

Более того, видеокарты на устройстве специалиста по безопасности также могут помочь вам в случае, если атака все-таки увенчалась успехом: например, если атака проведена старыми версиями шифровальщиков, использующих для шифрования не сертификаты, а PSK-ключи. Программу-взломщика можно будет просто взломать в ответ!

Видеокарта для Big Data

Но по большей части она протекает за высокими заборами ЦОДов, а вовсе не в офисах и даже не в офисных серверных. Тем не менее специализированные IT-конторы могут позволить себе создание собственной GPU-ориентированной инфраструктуры.

Она может, например, обеспечивать поиск и анализ открыто выложенных в Сети данных для маркетологических или иных исследований: если компании нужно выяснить, чем интересуется, что и как часто покупает ее целевая аудитория, то купить услугу такого анализа сегодня уже можно. И это дорогое удовольствие: фирмы, производящие такие исследования, можно перечесть по пальцам.

Из всего написанного выше следует вывод: свою естественную нишу, работу с графикой, видеокарты не теряют, зато расширяют свое влияние на совершенно, казалось бы, непредсказуемые области.

Даже средняя компания в условиях жесткой конкурентной борьбы может нуждаться в закупке нескольких карт для обеспечения цифровой безопасности. И средние, и небольшие компании могут немного поднять свой доход посредством майнинга на тех же картах. Ну а крупные или специализированные конторы, не имеющие никакого отношения к анимации или обработке видео, закупают их, чтобы использовать для анализа Big Data или создание нейросетей.

Для чего и зачем нужна хорошая видеокарта в компьютере кроме игр?

Привет, друзья! Компьютер, как известно, не просто навороченный медиацентр с выходом в интернет и возможностью запуска интереснейших игр – многими он используется и для работы. Сегодня обсудим тему, для чего нужна мощная видеокарта кроме игр и где используется еще такое устройство.

Майнинг криптовалют

Процесс добычи биткойнов и прочих Эфириумов скакнул далеко вперед. Видеокарты постепенно уступают место майнерам – специальным устройствам, которые при меньшем энергопотреблении дают более высокий хешрейт. Однако, это не мешает многим работать «по старинке», создавая фермы из нескольких мощных графических ускорителей.

Это стало причиной некоего дефицита видеокарт, особенно тех, что относятся к классу топовых устройств.

К сожалению, это же и стало причиной появления на рынке огромного числа таких девайсов, бывших в употреблении: после нескольких лет нещадной эксплуатации, такой графический ускоритель не отправляется на покой, а продается с целью «отбить» определенную сумму. Не рекомендую связываться – покупаете «кота в мешке».

Обучение и медицина

Использовать шлем виртуальной реальности в связке с мощным компьютером, в целях обучения иногда выходит дешевле: например, представьте, сколько нужно обучать пилота, чтобы он отлетал положенное количество часов.

А теперь посчитайте, сколько керосина при этом он сожжет и сколько это может стоить. Конечно, обучение с помощью VR – не полная замена, но неплохая помощь в процессе.

Согласно последним исследованиям ученых, использование специальных пространств виртуальной реальности позволяет бороться с некоторыми расстройствами мозга и нервной системы – например, старческой деменцией или проблемами вестибулярного аппарата.

Работа с графикой

Сюда можно включить не только моделирование 3D-объектов с помощью инженерных конструкторов, но и, казалось бы, такие тривиальные задачи, как обработку фотографий – новые версии Photoshop очень требовательны к мощности компа.

С другой стороны, зачем эти «излишества», если вы занимаетесь этим раз в году?

Видеомонтаж

Хороший видеоредактор – необходимый рабочий инструмент любого видеоблогера, видеографа или монтажера. Почти всегда, отснятый материал требует дополнительной обработки, особенно удаления лишнего, а также вставки различных эффектов.

Проведение стримов

Некоторые ошибочно полагают, что стримят только прохождением какой-либо игры. Отнюдь. При наличии фантазии, прямой эфир можно превратить в шоу – например, троллить народ в «Чат-рулетке» или провести сеанс ASMR-терапии.

Естественно, таким стримерам нужны хорошие, дорогие вебкамеры для трансляции качественного изображения, справиться с которым может только мощный GPU.

Вот в принципе, все задачи, которые мне удалось вспомнить. Если вам еще что-то пришло на ум, не стесняйтесь и пишите в комментариях.

А еще советую вам почитать публикации «Встроенная и интегрированная графика в процессоре» и «Выбираем процессор для домашнего компьютера». А о процессорах для рендеринга за 2017 и 2018 год вы можете узнать здесь.

Спасибо за внимание и до встреч на страницах моего блога! Не забудьте поделиться этой публикацией Вконтакте или Фейсбуке и подписаться на обновления.

Вычисления на GPU – зачем, когда и как. Плюс немного тестов

Всем давно известно, что на видеокартах можно не только в игрушки играть, но и выполнять вещи, никак не связанные с играми, например, нейронную сеть обучить, криптовалюту помайнить или же научные расчеты выполнить. Как так получилось, можно прочитать тут, а я хотел затронуть тему того, почему GPU может быть вообще интересен рядовому программисту (не связанному с GameDev), как подступиться к разработке на GPU, не тратя на это много времени, принять решение, нужно ли вообще в эту сторону смотреть, и «прикинуть на пальцах», какой профит можно получить.

Статья написана по мотивам моего выступления на HighLoad++. В ней рассматриваются в основном технологии, предлагаемые компанией NVIDIA. У меня нет цели рекламировать какие-либо продукты, я лишь привожу их в качестве примера, и наверняка что-то похожее можно найти у конкурирующих производителей.

Зачем что-то считать на GPU?

Два процессора можно сравнить по разным критериям, наверное, самые популярные — это частота и количество ядер, размер кэшей и прочее, но в конечном счете, нас интересует, сколько операций процессор может выполнить за единицу времени, что это за операции вопрос отдельный, но наиболее распространенной метрикой является количество операций с плавающей запятой в секунду — flops. И когда мы хотим сравнить теплое с мягким, а в нашем случае GPU с CPU, эта метрика приходится как нельзя кстати.

Ниже на графике изображены рост этих самых флопсов с течением времени для процессоров и для видеокарт.

(Данные собраны из открытых источников, нет данных за 2019-20 годы, т.к. там не все так красиво, но GPU все-таки выигрывают)

Что ж, заманчиво, не правда ли? Перекладываем все вычисления с CPU на GPU и получаем в восемь раз лучшую производительность!

Но, конечно же, не все так просто. Нельзя просто так взять и переложить все на GPU, о том почему, мы поговорим дальше.

Архитектура GPU и ее сравнение с CPU

Привожу многим знакомую картинку с архитектурой CPU и основными элементами:

Что здесь особенного? Одно ядро и куча вспомогательных блоков.

А теперь давайте посмотрим на архитектуру GPU:

У видеокарты множество вычислительных ядер, обычно несколько тысяч, но они объединены в блоки, для видеокарт NVIDIA обычно по 32, и имеют общие элементы, в т.ч. и регистры. Архитектура ядра GPU и логических элементов существенно проще, чем на CPU, а именно, нет префетчеров, бранч-предикторов и много чего еще.

Что же, это ключевые моменты отличия в архитектуре CPU и GPU, и, собственно, они и накладывают ограничения или, наоборот, открывают возможности к тому, что мы можем эффективно считать на GPU.

Я не упомянул еще один важный момент, обычно, видеокарта и процессор не «шарят» память между собой и записать данные на видеокарту и считать результат обратно — это отдельные операции и могут оказаться «бутылочным горлышком» в вашей системе, график зависимости времени перекачки от размера данных приведен далее в статье.

Ограничения и возможности при работе с GPU

Какие ограничения накладывает такая архитектура на выполняемые алгоритмы:

Приведение классических алгоритмов к SIMD-представлению

Трансформация

У нас есть два массива, A и B, и мы хотим к каждому элементу массива A добавить элемент из массива B. Ниже приведен пример на C, хотя, надеюсь, он будет понятен и тем, кто не владеет этим языком:

Классический обход элементов в цикле и линейное время выполнения.

А теперь посмотрим, как такой код будет выглядеть для GPU:

А вот здесь уже интересно, появилась переменная threadIdx, которую мы вроде бы нигде не объявляли. Да, нам предоставляет ее система. Представьте, что в предыдущем примере массив состоит из трех элементов, и вы хотите его запустить в трех параллельных потоках. Для этого вам бы понадобилось добавить еще один параметр – индекс или номер потока. Вот это и делает за нас видеокарта, правда она передает индекс как статическую переменную и может работать сразу с несколькими измерениями – x, y, z.

Еще один нюанс, если вы собираетесь запускать сразу большое количество параллельных потоков, то потоки придется разбить на блоки (архитектурная особенность видеокарт). Максимальный размер блока зависит от видеокарты, а индекс элемента, для которого выполняем вычисления, нужно будет получать так:

В итоге что мы имеем: множество параллельно работающих потоков, выполняющих один и тот же код, но с разными индексами, а соответственно, и данными, т.е. тот самый SIMD.

Это простейший пример, но, если вы хотите работать с GPU, вашу задачу нужно привести к такому же виду. К сожалению, это не всегда возможно и в некоторых случаях может стать темой докторской диссертации, но тем не менее классические алгоритмы все же можно привести к такому виду.

Агрегация

Давайте теперь посмотрим, как будет выглядеть агрегация, приведенная к SIMD представлению:

У нас есть массив из n элементов. На первом этапе мы запускаем n/2 потоков и каждый поток складывает по два элемента, т.е. за одну итерацию мы складываем между собой половину элементов в массиве. А дальше в цикле повторяем все тоже самое для вновь получившегося массива, пока не сагрегируем два последних элемента. Как видите, чем меньше размер массива, тем меньше параллельных потоков мы можем запустить, т.е. на GPU имеет смысл агрегировать массивы достаточно большого размера. Такой алгоритм можно применять для вычисления суммы элементов (кстати, не забывайте о возможном переполнении типа данных, с которым вы работаете), поиска максимума, минимума или просто поиска.

Сортировка

А вот с сортировкой уже все выглядит намного сложнее.

Два наиболее популярных алгоритма сортировки на GPU это:

Но идея в том, что даже такой нелинейный алгоритм, как сортировка, можно привести к SIMD-виду.

А теперь, прежде чем посмотреть на реальные цифры, которые можно получить от GPU, давайте разберемся, как же все-таки программировать под это чудо техники?

C чего начать

Наиболее распространены две технологии, которые можно использовать для программирования под GPU:

Использовать OpenCL можно из C/C++, есть биндинги к другим языкам.

По OpenCL мне больше всего понравилась книга «OpenCL in Action». В ней же описаны разные алгоритмы на GPU, в т.ч. Bitonic-sort и Radix-sort.

CUDA – это проприетарная технология и SDK от компании NVIDIA. Писать можно на C/C++ или использовать биндинги к другим языкам.

Сравнивать OpenCL и CUDA несколько не корректно, т.к. одно — стандарт, второе — целое SDK. Тем не менее многие выбирают CUDA для разработки под видеокарты несмотря на то, что технология проприетарная, хоть и бесплатная и работает только на картах NVIDIA. Тому есть несколько причин:

Наиболее полноценной книгой по CUDA, на которую я наткнулся, была «Professional CUDA C Programming», хоть уже и немного устарела, тем не менее в ней рассматривается много технических нюансов программирования для карт NVIDIA.

А что, если я не хочу тратить пару месяцев на чтение этих книг, написание собственной программы для видеокарты тестирование и отладку, а потом выяснить, что это все не для меня?

Как я уже сказал, есть большое количество библиотек, которые скрывают сложности разработки под GPU: XGBoost, cuBLAS, TensorFlow, PyTorch и другие, мы рассмотрим библиотеку thrust, так как она менее специализирована, чем другие вышеприведенные библиотеки, но при этом в ней реализованы базовые алгоритмы, например, сортировка, поиск, агрегация, и с большой вероятностью она может быть применима в ваших задачах.

Thrust – это С++ библиотека, которая ставит своей целью «подменить» стандартные STL алгоритмы на алгоритмы выполняемые на GPU. Например, сортировка массива чисел с помощью этой библиотеки на видеокарте будет выглядеть так:

(не забываем, что пример нужно компилировать компилятором от NVIDIA)

Как видите, thrust::sort очень похож на аналогичный алгоритм из STL. Эта библиотека скрывает много сложностей, в особенности разработку подпрограммы (точнее ядра), которая будет выполняться на видеокарте, но при этом лишает гибкости. Например, если мы хотим отсортировать несколько гигабайт данных, логично было бы отправить кусок данных на карту запустить сортировку, и пока выполняется сортировка, дослать еще данные на карту. Такой подход называется latency hiding и позволяет более эффективно использовать ресурсы серверной карты, но, к сожалению, когда мы используем высокоуровневые библиотеки, такие возможности остаются скрытыми. Но для прототипирования и замера производительности как раз таки подходят, в особенности с thrust можно замерить, какой оверхед дает пересылка данных.

Я написал небольшой бенчмарк с использованием этой библиотеки, который выполняет несколько популярных алгоритмов с разным объемом данных на GPU, давайте посмотрим, какие результаты получились.

Результаты выполнения алгоритмов на GPU

Для тестирования GPU я взял инстанс в AWS с видеокартой Tesla k80, это далеко не самая мощная серверная карта на сегодняшний день (самая мощная Tesla v100), но наиболее доступная и имеет на борту:

Трансформация

Время выполнения трансформации на GPU и CPU в мс

Как видите, обычная трансформация элементов массива выполняется по времени примерно одинаково, как на GPU, так и на CPU. А все почему? Потому что оверхед на пересылку данных на карту и обратно съедает весь performance boost (про оверхед мы поговорим отдельно), да и вычислений на карте выполняется относительно немного. К тому же не стоит забывать, что процессоры также поддерживают SIMD инструкции, и компиляторы в простых случаях могут эффективно их задействовать.

Давайте теперь посмотрим, насколько эффективно выполняется агрегация на GPU.

Агрегация

Время выполнения агрегации на GPU и CPU в мс

В примере с агрегацией мы уже видим существенный прирост производительности с увеличением объема данных. Стоит также обратить внимание на то, что в память карты мы перекачиваем большой объем данных, а назад забираем только одно агрегированное значение, т.е. оверхед на пересылку данных из карты в RAM минимален.

Перейдем к самому интересному примеру – сортировке.

Сортировка

Время выполнения сортировки на GPU и CPU в мс

Несмотря на то, что мы пересылаем на видеокарту и обратно весь массив данных, сортировка на GPU 800 MB данных выполняется примерно в 25 раз быстрее, чем на процессоре.

Оверхед на пересылку данных

Как видно из примера с трансформацией, не всегда очевидно, будет ли GPU эффективен даже в тех задачах, которые хорошо параллелятся. Причиной тому — оверхед на пересылку данных из оперативной памяти компьютера в память видеокарты (в игровых консолях, кстати, память расшарена между CPU и GPU, и нет необходимости пересылать данные). Одна из характеристик видеокарты это — memory bandwidth или пропускная способность памяти, которая определяет теоретическую пропускную способность карты. Для Tesla k80 это 480 GB/s, для Tesla v100 это уже 900 GB/s. Также на пропускную способность будет влиять версия PCI Express и имплементация того, как вы будете передавать данные на карту, например, это можно делать в несколько параллельных потоков.

Давайте посмотрим на практические результаты, которые удалось получить для видеокарты Tesla k80 в облаке Amazon:

Время пересылки данных на GPU, сортировки и пересылки данных обратно в RAM в мс

HtoD – передаем данные на видеокарту

GPU Execution – сортировка на видеокарте

DtoH – копирование данных из видеокарты в оперативную память

Первое, что можно отметить – считывать данные из видеокарты получается быстрее, чем записывать их туда.

Второе – при работе с видеокартой можно получить latency от 350 микросекунд, а этого уже может хватить для некоторых low latency приложений.

Ниже на графике приведен оверхед для большего объема данных:

Время пересылки данных на GPU, сортировки и пересылки данных обратно в RAM в мс

Серверное использование

Наиболее частый вопрос — чем отличается игровая видеокарта от серверной? По характеристикам они очень похожи, а цены отличаются в разы.

Основные отличия серверной (NVIDIA) и игровой карты:

Многопоточность

После того как мы разобрались, как запустить простейший алгоритм на видеокарте и каких результатов можно ожидать, следующий логичный вопрос, а как будет себя вести видеокарта при обработке нескольких параллельных запросов. В качестве ответа у меня есть два графика выполнения вычислений на GPU и процессоре с 4-мя и 32-мя ядрами:

Время выполнения математических расчетов на GPU и CPU c матрицами размером 1000 x 60 в мс

На этом графике выполняются расчеты с матрицами размером 1000 x 60 элементов. Запускаются вычисления из нескольких программных потоков, для GPU дополнительно создается отдельный stream для каждого CPU-потока (используется тот самый Hyper-Q).

Как видно, процессор справляется с такой нагрузкой очень хорошо, при этом latency для одного запроса на GPU существенно растет с увеличением числа параллельных запросов.

Время выполнения математических расчетов на GPU и CPU c матрицами 10 000 x 60 в мс

На втором графике те же самые вычисления, но с матрицами в 10 раз больше, и GPU под такой нагрузкой ведет себя существенно лучше. Эти графики очень показательны, и можно сделать вывод: поведение под нагрузкой зависит от характера самой нагрузки. Процессор может также довольно эффективно справляться с матричными вычислениями, но до определенных пределов. Для видеокарты характерно то, что для небольшой вычислительной нагрузки производительность падает примерно линейно. С увеличением нагрузки и количества параллельных потоков видеокарта справляется уже лучше.

Сложно строить гипотезы, как будет себя вести GPU в различных ситуациях, но, как видите, при определенных условиях серверная карта может достаточно эффективно обрабатывать запросы из нескольких параллельных потоков.

Обсудим еще несколько вопросов, которые могут возникнуть у вас, если вы все-таки решили использовать GPU в своих проектах.

Ограничение ресурсов

Как мы уже говорили, два основных ресурса видеокарты – это вычислительные ядра и память.

К примеру, у нас несколько процессов или контейнеров, использующих видеокарту, и хотелось бы иметь возможность поделить видеокарту между ними. К сожалению, простого API для этого нет. NVIDIA предлагает технологию vGPU, но карту Tesla k80 я не нашел в списке поддерживаемых, и насколько мне удалось понять из описания, технология больше заточена на виртуальные дисплеи, чем на вычисления. Возможно, AMD предлагает что-то более подходящее.

Поэтому, если планируете использовать GPU в своих проектах, стоит рассчитывать на то, что приложение будет использовать видеокарту монопольно, либо вы будете программно контролировать объем выделяемой памяти и количество ядер, используемых для вычислений.

Контейнеры и GPU

Если с ограничением ресурсов вы разобрались, то следующий логичный вопрос: а если в сервере несколько видеокарт?

Опять же, можно на уровне приложения решать, какой GPU оно будет использовать.

Другой более удобный способ – это Docker-контейнеры. Можно использовать и обычные контейнеры, но NVIDIA предлагает свои контейнеры NGC, с оптимизированными версиями различного софта, библиотек и драйверов. Для одного контейнера можно ограничить количество используемых GPU и их видимость для контейнера. Оверхед на использования контейнера около 3%.

Работа в кластере

Другой вопрос, что делать, если вы хотите выполнять одну задачу на нескольких GPU в рамках одного сервера или кластера?

Если вы выбрали библиотеку на подобии thrust или более низкоуровневое решение, то задачу придется решать вручную. Высокоуровневые фреймворки, например, для машинного обучения или нейронных сетей, обычно поддерживают возможность использования нескольких карт из коробки.

Дополнительно хотелось бы отметить то, что, например, NVIDIA предлагает интерфейс прямого обмена данными между картами – NVLINK, который существенно быстрее чем PCI Express. И есть технология прямого доступа к памяти карты из других PCI Express устройств – GPUDirect RDMA, в т.ч. и сетевых.

Рекомендации

Если вы размышляете об использовании GPU в своих проектах, то GPU, скорее всего, вам подойдет если: